Piloten von ferngesteuerten Kampfdrohnen haben keine Hemmungen beim Töten: "Playstation-Mentalität" - so sehen es viele Kritiker. Befürworter der Drohnentechnologie indes betonen, dass die Piloten - obwohl fernab vom Kampfgeschehen - viel genauer auf dem Monitor verfolgen können, was die Waffe angerichtet hat und sehr genau wissen, was sie tun. Psychologische Forschungen dazu gibt es leider kaum, bedauert Dr. Niklas Schörnig von der Hessischen Stiftung Friedens- und Konfliktforschung.

"Studien zeigen, dass unter Drohnenpiloten mindestens gleich hohe Raten posttraumatischen Stresses zu finden sind wie bei Kampfpiloten. Möglicherweise sogar mehr. Insoweit denke ich, dass wir hier nicht sagen können, es kommt zu einer systematischen Enthemmung, dass alle Piloten das als Computerspiel wahrnehmen. Das kann bei einzelnen der Fall sein. Aber andere - auch durch eine gute Ausbildung - werden da sicherlich auch verantwortungsbewusst mit umgehen können. Insoweit glaube ich, dass wir hier erst mal nicht sagen können, welcher Effekt dann in der Summe überwiegt. Hier gibt es wenige Studien. Also man hat relativ wenig Einblicke, aber ich halte beide Argumente für sehr plausibel."

In den Augen der Politiker - allen voran in den USA und Israel - haben Drohnen klare Vorteile: Sie minimieren das Risiko für die eigenen Soldaten. Sie sind mit ihrer IT-Technologie menschlichen Gegnern haushoch überlegen. Sie verändern allerdings auch die Kriegsführung, meint Dr. Frank Sauer, wissenschaftlicher Mitarbeiter der Universität der Bundeswehr in München:

"Der erste Grund ist natürlich, dass überhaupt keine Risiken für Drohnenpiloten mehr bestehen, wenn sie tatsächlich von zuhause aus im klimatisierten Container Krieg führen können. Und das Zweite ist die Möglichkeit, erstmalig so eine Art Dauerüberwachung zu haben durch diese Systeme. Also die haben sehr hohe Stehzeiten. Die können in Schichtsystemen mehr oder weniger ein großes Zielgebiet dauerhaft überwachen und man kann durch die Waffensysteme jetzt erstmalig auch innerhalb kürzester Zeit dann sofort Ziele bekämpfen."

Nach einer aktuellen Umfrage ist die Mehrheit der deutschen Bevölkerung - rund 70 Prozent - für den Einsatz von automatisierten Kampfdrohnen. Neuerdings. Denn in früheren Umfragen waren die Bedenkenträger noch in der Mehrzahl. Auch in den USA ist die Bevölkerung mehrheitlich für den Einsatz von Drohnen, wie jüngste Umfragen gezeigt haben. Doch bezieht sich die Zustimmung nur auf automatisierte, von Menschenhand gesteuerte Systeme. Autonom agierende Roboter, die auch die Entscheidung zum Töten quasi automatisch erledigen, werden von den meisten Amerikanern abgelehnt.

"Also es ist ganz offensichtlich dem Menschen nicht wohl dabei. Ich kann es nicht genau sagen, woran es liegt, ich kann es mir in Ansätzen erklären, dass man möglicherweise zurückschreckt davor, weil wir als Menschen intuitiv erkennen, dass ja die Maschine menschliches Leben nicht verstehen kann und möglicherweise gar nicht wertschätzen kann. Und dass deswegen es irgendwie grundsätzlich uns falsch vorkommt, dass diese Maschine über menschliches Leben entscheidet, einfach weil sie gar keinen Begriff davon hat."

Systeme von Robotern gesteuert?

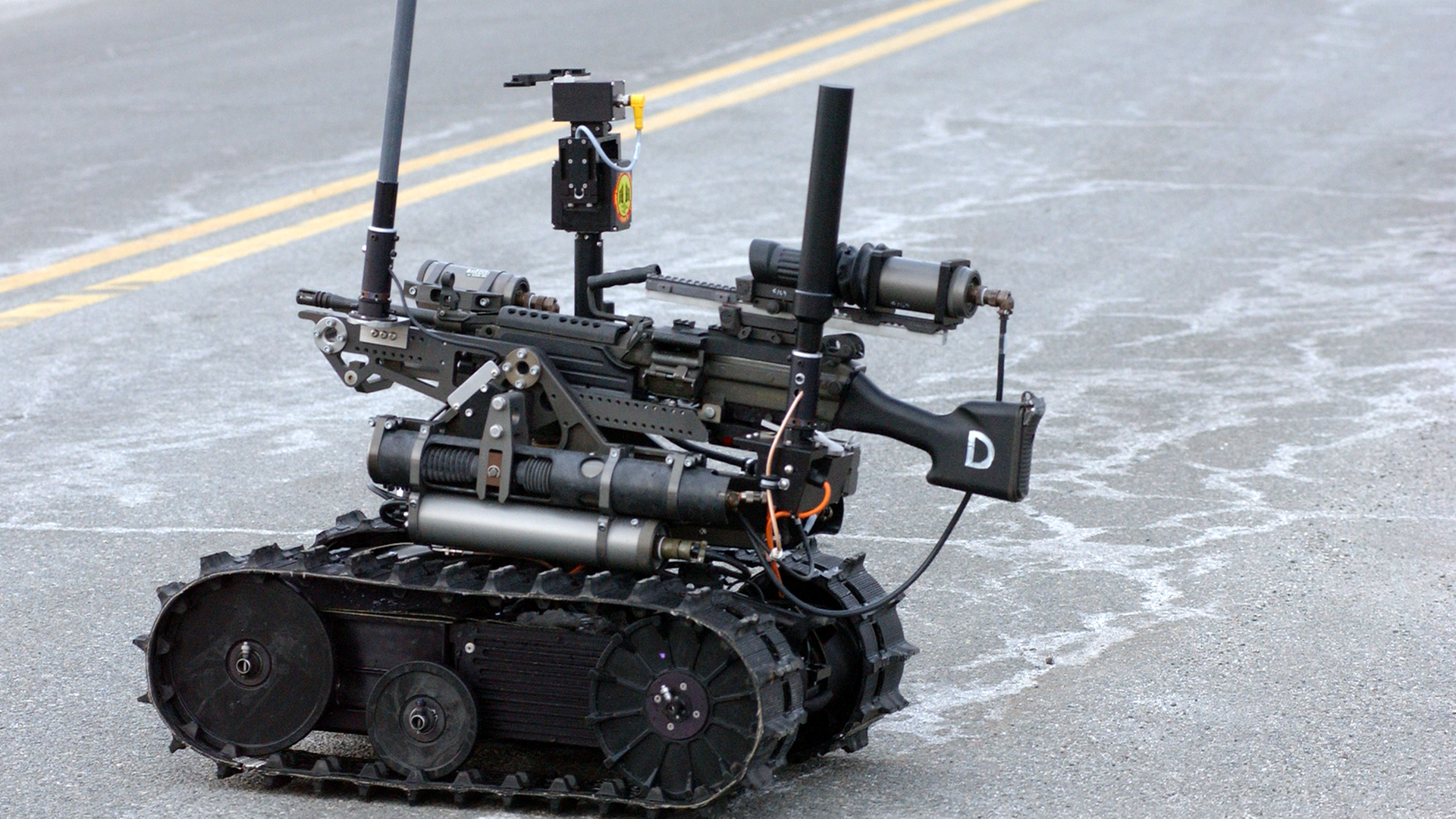

Noch immer werden sämtliche Systeme - Aufklärungs- wie auch Kampfdrohnen - ferngesteuert von Menschenhand. Der Pilot ist in den USA sogar umgeben von einer Mannschaft - darunter auch Juristen, die abwägen, ob ein möglicher Angriff zum Beispiel mit dem Völkerrecht kollidiert. So gesehen erscheinen Angriffe mit Drohnen eher "kühl kalkuliert", im Gegensatz zu der hektischen Situation im Cockpit eines bemannten Kampfjets. Durch die enormen Fortschritte in der Robotik und auch in der Entwicklung von künstlicher Intelligenz werden die Systeme in absehbarer Zeit völlig ohne Menschen agieren können, sorgt sich Dr. Jürgen Altmann. Der Physiker von der TU Dortmund, Mitglied im "International Committee for Robot Arms Control", sieht in den autonom agierenden Systemen eine Gefahr für den Weltfrieden.

"Wir müssen uns klar machen, dass es ja nicht nur um Szenarien geht wie jetzt in Afghanistan oder Nordwest-Pakistan oder Somalia, wo eine Seite die absolute Lufthoheit hat, sondern dass es viele verschiedene Länder geben wird, die unbemannte Flugzeuge, Landfahrzeuge und so weiter haben werden. Man muss sich vorstellen, eine solche Flotte wäre von der jeweiligen Seite programmiert auf ein bestimmtes Verhalten, insbesondere wenn sie autonom entscheiden sollen wegen der Laufzeiten oder der Störung der Kommunikationsverbindung. Und wir hätten zwei Systeme, die irgendwie programmiert werden von der jeweils eigenen Seite. Wie die miteinander wechselwirken, wie die auf unklare Ereignisse reagieren, dass kann keiner vorher sehen. Und keiner kann das vorher ausprobieren, weil das ja militärische Systeme sind, die gegenseitig abgeschottet sind."

Die Börse hat mehrfach schon erlebt, was passiert, wenn Computer die Regie übernehmen: Wie aus heiterem Himmel purzelten binnen weniger Minuten die Aktienkurse. Und die Börsianer konnten nichts dagegen tun. Um einen maschinell bedingten Crash in bewaffneten Konflikten zu vermeiden, müsse der Mensch in der "Entscheidungsschleife" der Kampfmaschinen eingebunden bleiben, so die einhellige Meinung auf der Loccumer Tagung. Dabei ist heute schon absehbar, dass es Regime geben wird, die bewusst darauf verzichten werden, um einen zeitlichen Vorsprung zu gewinnen, der militärisch mitunter entscheidend sein könnte. Dr. Jürgen Schmid vom Institut für Friedensforschung und Sicherheitspolitik, Hamburg, sieht hier erheblichen Regelungsbedarf.

"Also im Hinblick auf die Ächtung von Drohnen ist der Zug schon abgefahren. Aber in Hinblick auf die Frage der Automatisierung von Waffensystemen, da würde es, denke ich, Sinn machen, sich über mögliche Strategien Gedanken zu machen, wie man eine solche mögliche, aber nicht zwangsläufige Entwicklung rechtzeitig einebnen kann."

Dass am Ende autonom agierende Kampfroboter existieren, die ohne menschliches Zutun überlebenswichtige Entscheidungen treffen können, scheint eine logische Folge bei der Perfektionierung solcher Systeme zu sein. Dem müsse Einhalt geboten werden durch vertragliche Regelungen ähnlich dem Atomwaffensperrvertrag, so die Experten in der "Evangelischen Akademie Loccum". Diesmal ginge es allerdings um eine Waffe, die dann schon verboten wäre, bevor es sie gibt. Ein Novum in der Militärgeschichte.